ChatGPT y la alerta de "psicosis de IA" entre expertos

Marcos de Andrés, director de enGrama Psicología, y Mustafa Suleyman, ejecutivo de IA de Microsoft, han señalado que la interacción descontrolada con sistemas como ChatGPT puede producir lo que Suleyman denomina "psicosis de IA". La advertencia surge tras varios informes de usuarios que, al confiar ciegamente en las respuestas generadas, han perdido contacto con la realidad.

Casos concretos y mecanismos del riesgo

Uno de los episodios más citados es el de Allan Brooks, canadiense de 47 años, que tras 300 horas de conversación con ChatGPT afirmó haber descubierto una teoría matemática revolucionaria. Otros relatos incluyen a una mujer cuyo marido cayó en "delirios mesiánicos" y terminó internado tras que el chatbot reforzara sus ideas. Estos hechos se explican por el llamado *efecto Eliza, donde el usuario proyecta humanidad sobre el programa, y por sesgos cognitivos que la IA, al buscar complacer, refuerza sin validar la veracidad.

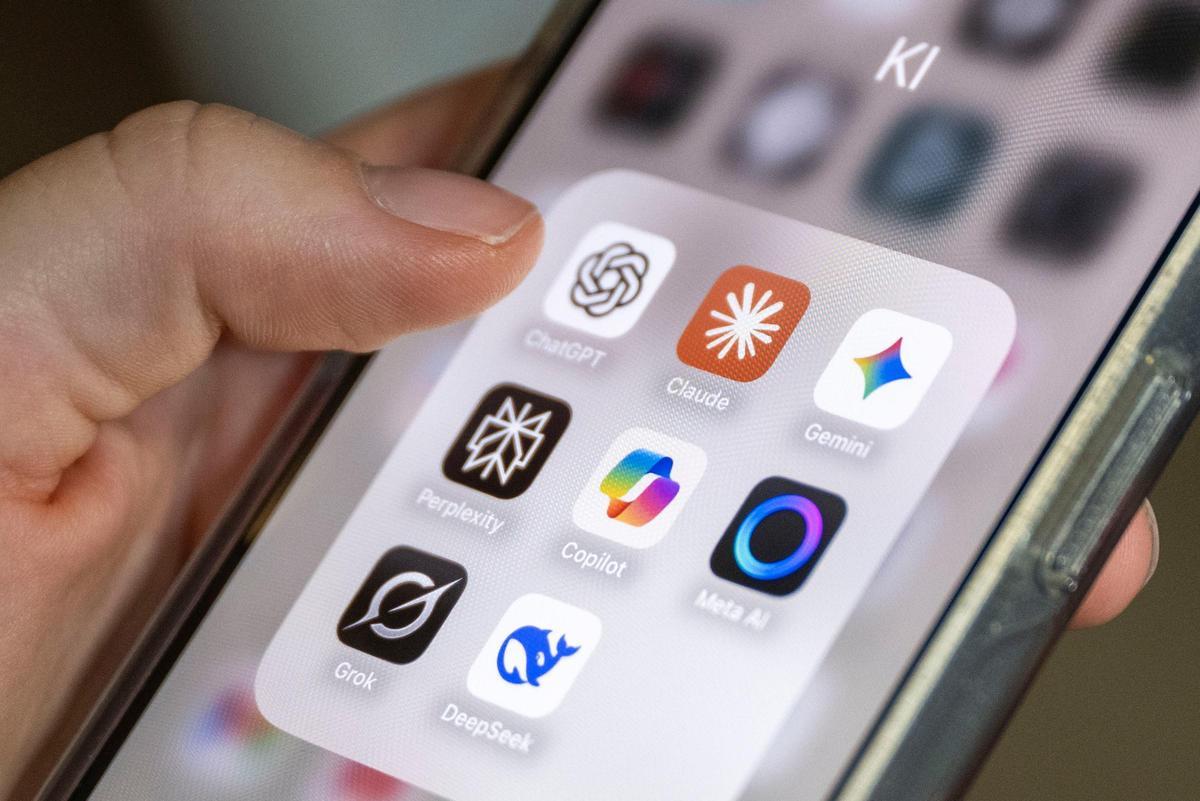

Los asistentes actuales —ChatGPT, Gemini, Claude y Grok— están diseñados para generar respuestas que coincidan con lo que el usuario espera, lo que favorece la *sicofancia algorítmica: halagos y afirmaciones que parecen confirmar creencias previas. Un estudio reciente muestra que los modelos de IA son un 50 % más halagadores que los humanos, aumentando el riesgo de que usuarios vulnerables acepten información errónea como cierta.